Nel primo trimestre del 2026, il panorama degli strumenti di intelligenza artificiale per lo sviluppo software ha vissuto una trasformazione significativa, incentrata su un nuovo criterio fondamentale: il Model Context Protocol (MCP). Non si tratta di un semplice aggiornamento delle funzionalità già esistenti, né di un ennesimo restyling dell’interfaccia utente. La questione cruciale che ogni organizzazione deve ora considerare quando valuta un nuovo strumento è cambiata radicalmente: non è più sufficiente che un tool produca output di qualità accettabile; deve dimostrare la capacità di operare in modo affidabile all’interno di un contesto aziendale reale.

Questo cambiamento di prospettiva ha catapultato il MCP al centro del dibattito tecnico. Non è un semplice strumento in competizione con altri; rappresenta uno standard che definisce come i modelli di intelligenza artificiale interagiscono con risorse esterne, quali database, API, file system e strumenti interni. La sua importanza per i team di sviluppo, e sempre più per le organizzazioni non tecnologiche che stanno adottando soluzioni AI, risiede proprio in questo aspetto: il MCP delinea il perimetro operativo reale di un agente, piuttosto che quello idealizzato presentato nelle slide dei fornitori.

Il mercato MCP si è strutturato: tre categorie, tre logiche diverse

Oggi, chi si trova a dover prendere decisioni opera in un mercato decisamente più maturo rispetto a un anno fa. Gli strumenti disponibili si sono consolidati attorno a tre categorie funzionali distinte, ognuna con un proprio profilo d’uso, un modello di governance specifico e una curva di adozione unica.

AI App Builder: Queste piattaforme sono progettate per la rapida generazione di applicazioni, utilizzando prompt in linguaggio naturale. Offrono il tempo di prototipazione più breve sul mercato, risultando ideali per contesti in cui l’obiettivo è validare un’ipotesi senza investire risorse significative nello sviluppo. Tuttavia, il loro limite strutturale emerge quando il perimetro di utilizzo si espande, affrontando sfide come sistemi dati complessi, politiche di accesso e requisiti di conformità.

Assistant Integrati negli IDE: Questi strumenti sono integrati nel flusso di lavoro quotidiano degli sviluppatori, offrendo funzionalità come completamento intelligente, refactoring assistito, analisi della codebase e generazione e revisione dei test. Questa categoria ha raggiunto un elevato grado di maturità tecnica. La differenza tra i prodotti concorrenti si basa sempre meno sulle funzionalità di base e sempre più sulla qualità dell’integrazione con lo stack aziendale e sul controllo degli accessi e dei comportamenti.

Agenti Open Source da Terminale: Questa categoria, sebbene meno intuitiva in termini di esperienza utente, offre il massimo grado di controllabilità. Permette una configurazione esplicita, un audit trail verificabile e una totale libertà nella scelta del modello sottostante, senza vincoli verso infrastrutture proprietarie. Per team tecnici esperti, questi strumenti rappresentano spesso la scelta più vantaggiosa nel medio-lungo periodo.

Il Model Context Protocol si inserisce trasversalmente in queste tre categorie, fornendo un livello di astrazione che consente di confrontarle non solo in base alle funzionalità dichiarate, ma anche in base alla reale capacità di integrazione con sistemi esistenti.

I criteri MCP

I criteri di valutazione per un agente AI non possono limitarsi alla qualità del codice generato, alla velocità di risposta e alla fluidità dell’interfaccia. Questi aspetti, sebbene fondamentali, risultano insufficienti per una valutazione approfondita. Quando un agente AI opera in prossimità di repository di produzione, database aziendali o pipeline di rilascio, è essenziale considerare criteri di livello superiore che garantiscano affidabilità e sicurezza nel contesto aziendale.

Profondità del contesto operativo

La differenza tra un assistente AI e un agente AI operativo non è di grado, è di tipo. Un assistente elabora input e produce output nel perimetro della conversazione. Un agente operativo interroga fonti dati, richiama strumenti, legge schemi, esegue funzioni e lavora su risorse preesistenti. MCP è lo standard che abilita questa seconda modalità in modo strutturato. Valutare un tool senza verificare la qualità della sua implementazione MCP significa valutare solo metà dello strumento.

Portabilità MCP e riutilizzo delle integrazioni

Ogni integrazione realizzata su misura rappresenta un debito tecnico. Il Model Context Protocol affronta questa problematica standardizzando l’accesso dei modelli a strumenti e risorse esterne. Per le organizzazioni, ciò si traduce in integrazioni più resilienti, meno vincolate alla roadmap di un fornitore specifico e facilmente riutilizzabili in diversi ambienti e per vari clienti. Questo vantaggio, sebbene non immediatamente evidente in una demo di trenta minuti, diventa cruciale quando l’adozione si espande e si intensifica.

Governance: accessi e tracciabilità

La governance è un aspetto spesso sottovalutato nelle fasi iniziali di valutazione, ma è cruciale per evitare costosi problemi in seguito. Un agente AI che ha accesso a dati sensibili, può modificare file o eseguire azioni su sistemi interni deve operare all’interno di un rigoroso framework di controllo. Questo include una gestione dettagliata dei permessi, un audit trail completo, la separazione tra ambienti di test e produzione, e meccanismi di masking per proteggere i dati riservati. Se il fornitore non fornisce risposte chiare e dettagliate su questi aspetti fondamentali, è un chiaro segnale che il tool non è ancora pronto per un contesto enterprise.

MCP Apps: dall’architettura all’operatività

Negli ultimi tempi, il Model Context Protocol ha attirato un’attenzione sempre maggiore, estendendo la sua influenza oltre i confini dei soli team tecnici. La sua importanza per le funzioni aziendali e per le organizzazioni con strutture tecniche meno definite è diventata sempre più evidente.

L’introduzione delle MCP Apps ha rappresentato un significativo punto di svolta in questo scenario.

Oggi, il MCP non si limita a collegare un modello a uno strumento esterno; offre la possibilità di integrare componenti di interfaccia interattivi — come dashboard, moduli, flussi di lavoro operativi e visualizzazioni di dati — direttamente all’interno dei client di intelligenza artificiale già in uso, come Claude, ChatGPT, Goose o VS Code. Il risultato va oltre una semplice risposta testuale arricchita: si tratta di un elemento di interfaccia operativo, facilmente riutilizzabile su diverse piattaforme senza necessità di riscrittura.

Per le organizzazioni che sviluppano applicazioni interne o automatizzano flussi di lavoro aziendali, le implicazioni pratiche sono significative. Un componente progettato una sola volta può essere distribuito su più client, evitando così la proliferazione dei costi di sviluppo e manutenzione. Questo approccio non solo riduce il rischio tecnico — grazie a integrazioni meno fragili e meno dipendenti da un singolo ambiente — ma abbassa anche i costi di sperimentazione, permettendo di validare casi d’uso operativi prima di intraprendere sviluppi più ampi.

Tre strumenti a confronto: OpenCode, Goose, Antigravity

L’analisi comparativa degli strumenti emergenti tra marzo e aprile 2026 mette in luce tre approcci architetturali distintivi, ognuno dei quali presenta implicazioni specifiche in termini di governance, costi e lock-in.

OpenCode e MCP: controllo e auditabilità

OpenCode rappresenta l’apice della tecnologia degli agenti open source per il coding. La sua crescente adozione è sintomo di un’evoluzione nelle priorità dei team tecnici: sebbene la qualità dell’output rimanga un fattore cruciale, la controllabilità dell’intero processo ha acquisito un’importanza equivalente.

I vantaggi che rendono OpenCode distintivo in un contesto enterprise sono ben definiti. La possibilità di sostituire il modello linguistico sottostante senza alterare il workflow operativo offre una flessibilità preziosa nella gestione dei costi e nell’adattamento alle dinamiche di mercato in continua evoluzione.

Un’attenta pianificazione prima di apportare modifiche al codice introduce una fase di verifica che mitiga il rischio di interventi non intenzionali su codebase critiche. Inoltre, l’auditabilità delle sessioni soddisfa direttamente i requisiti di tracciabilità che molte organizzazioni enterprise non possono permettersi di trascurare. Infine, il supporto nativo per i workflow versionati si integra perfettamente con le pratiche di sviluppo consolidate, rendendo OpenCode una scelta strategica per le aziende che puntano all’eccellenza.

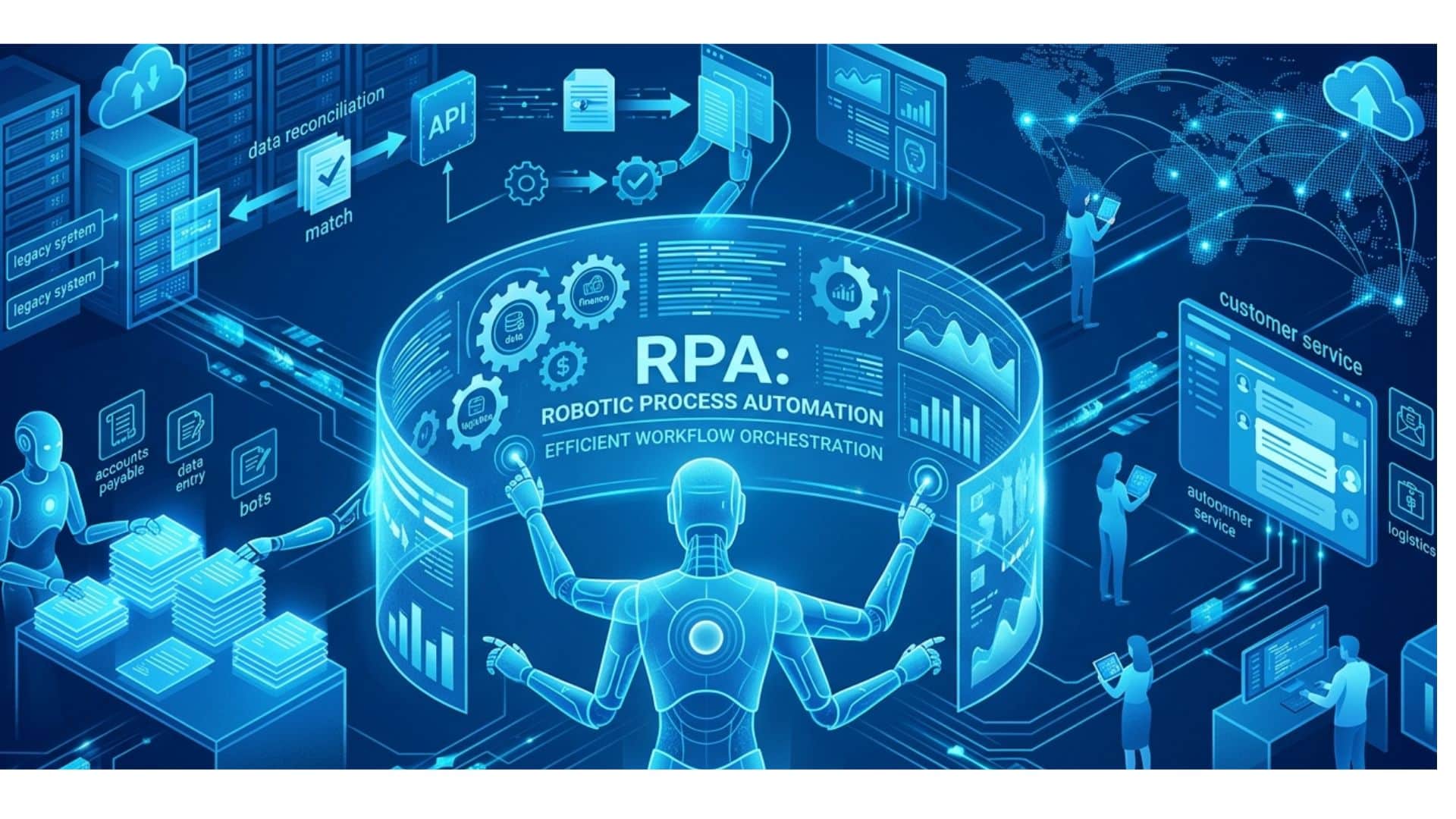

Goose e MCP: lo stack agentico aperto

Goose si posiziona in modo distintivo all’interno dello stack agentico aperto. Grazie al supporto nativo per il Model Context Protocol e alla sua capacità di operare su desktop, CLI e API, si configura come uno strumento non destinato esclusivamente al singolo sviluppatore, ma piuttosto a ecosistemi in cui più agenti collaborano su compiti distribuiti attraverso protocolli aperti.

Questo profilo risulta particolarmente attraente per le organizzazioni che non sono in cerca di un semplice assistente di coding, ma aspirano a costruire un’infrastruttura agentica modulare e scalabile. Il valore di Goose emerge in modo significativo in scenari di composizione, dove agenti specializzati si coordinano attraverso interfacce standardizzate, contribuendo a ridurre la dipendenza da soluzioni monolitiche.

In questo contesto, Goose si distingue come una scelta strategica per le aziende che desiderano ottimizzare la loro operatività, favorendo la collaborazione tra diversi agenti e garantendo una maggiore flessibilità e adattabilità alle esigenze in continua evoluzione del mercato.

Antigravity e MCP: integrazione enterprise Google Cloud

Antigravity si posiziona in un segmento ben definito: ambienti enterprise caratterizzati da un’integrazione profonda con lo stack Google Cloud. L’accesso diretto a strumenti come BigQuery, AlloyDB, Looker, Spanner e Cloud SQL, attraverso server MCP dedicati, elimina i passaggi di contesto tra IDE, client SQL e strumenti di analytics. Questo approccio riduce significativamente la frizione operativa per i team che gestiscono intensamente dati strutturati.

Tuttavia, il trade-off è altrettanto chiaro. La robustezza dell’integrazione con l’ecosistema Google offre un vantaggio tangibile per coloro che hanno già investito in questo stack, ma comporta anche una dipendenza infrastrutturale che deve essere valutata con attenzione prima di procedere all’adozione. Non si tratta di una criticità assoluta, ma di un fattore che deve essere considerato nell’analisi decisionale, evitando che emerga solo in un secondo momento.

La domanda cruciale da porsi durante una valutazione comparativa non è quale strumento generi il codice migliore in condizioni ideali. È piuttosto quale modello operativo (in termini di governance, costi, portabilità e dipendenze) si accetta di adottare insieme al tool.

Valutazione MCP per organizzazioni non tech

Le organizzazioni prive di un team di sviluppo strutturato spesso commettono un errore sistematico nella valutazione degli strumenti di intelligenza artificiale: tendono a privilegiare l’impatto immediato di una demo piuttosto che la solidità del processo sottostante. Questo porta a un ciclo ricorrente: un’adozione entusiasta, seguita da una rapida produzione di prototipi, fino a un inevitabile stallo operativo quando il contesto reale richiede governance, tracciabilità e integrazione con sistemi esistenti.

Cinque verifiche indispensabili

Per rompere questo ciclo, è fondamentale ridefinire il framework di valutazione. Le domande chiave non devono concentrarsi sulla qualità dell’output in scenari controllati, ma piuttosto sulla capacità dello strumento di operare in contesti reali, affrontando vincoli concreti. Prima di procedere all’adozione, è necessario condurre verifiche in cinque aree specifiche:

- Compatibilità con i sistemi esistenti: Lo strumento si integra con le fonti dati, gli strumenti e i flussi di lavoro già in uso, attraverso standard aperti come il Model Context Protocol, o richiede integrazioni proprietarie che creano dipendenze?

- Controllabilità degli accessi: È possibile definire in modo granulare quali risorse l’agente può interrogare o modificare? Esiste un meccanismo di audit che consenta di verificare le azioni effettuate?

- Applicabilità a processi reali: Le funzionalità del tool sono sostenibili in processi operativi effettivi, o il valore si esaurisce in scenari semplificati creati per la presentazione?

- Modello economico a lungo termine: Qual è il costo reale di adozione, inclusi i costi di configurazione, manutenzione e potenziale migrazione? Il modello di licensing è compatibile con una crescita dell’utilizzo?

- Capacità di adozione interna: Chi utilizzerà concretamente lo strumento, con quale frequenza e a quale livello di autonomia tecnica? La risposta a questa domanda spesso determina più di qualsiasi valutazione funzionale.

Adottare un approccio più strategico e consapevole nella valutazione degli strumenti AI non solo migliora l’efficacia operativa, ma prepara anche le organizzazioni a sfruttare appieno il potenziale delle tecnologie emergenti.

Checklist per CTO e IT manager

Per i professionisti incaricati della selezione e implementazione degli strumenti, è essenziale adottare un approccio analitico approfondito. Di seguito, esploreremo le aree di verifica che meritano particolare attenzione prima di procedere con l’adozione in produzione.

Gestione del contesto di progetto

Gli agenti che operano su codebase reali necessitano di un contesto stabile e versionato. Documenti come AGENTS.md, contenenti istruzioni operative, comandi di build e test, politiche e convenzioni di progetto, consentono di trasformare la configurazione degli agenti da una dimensione conversazionale e volatile a una dimensione documentale persistente e condivisibile tra i team.

Integrazione con l’infrastruttura esistente

Il Model Context Protocol genera valore tangibile quando connette l’agente a database, sistemi di osservabilità, CRM, strumenti di business intelligence e pipeline CI/CD già in uso. Se questa connettività rimane solo una voce nelle specifiche tecniche, senza tradursi in integrazioni funzionanti e verificate, il valore dello standard non viene realizzato.

Perimetro di sicurezza MCP. Ogni agente che interagisce con sistemi interni deve operare all’interno di un perimetro di sicurezza ben definito: ambienti di test isolati dalla produzione, masking dei dati sensibili, politiche di autorizzazione basate su ruoli e audit trail verificabile. L’assenza di requisiti chiari su questi aspetti è un chiaro indicativo che il progetto non ha ancora raggiunto la maturità necessaria per scalare in produzione.

Struttura economica e sostenibilità

La scelta tra soluzioni proprietarie e open source non ha una risposta univoca. Gli strumenti proprietari tendono ad accelerare l’adozione iniziale e a ridurre i costi di configurazione. D’altro canto, le soluzioni open source offrono maggiore trasparenza sui costi, libertà nella scelta del modello e assenza di lock-in vendor. La variabile decisiva è la traiettoria dell’organizzazione nel medio periodo, piuttosto che la convenienza immediata.

Piano di adozione realistico

Uno strumento tecnicamente superiore che non viene adottato dal team rappresenta un costo, non un investimento. La valutazione dell’adottabilità reale (chi lo utilizzerà, in quale workflow e con quale supporto) è parte integrante della decisione, non un dettaglio da affrontare successivamente.

Implementare MCP: approccio raccomandato per iniziare

Il rischio principale nella fase attuale del mercato non è restare indietro rispetto ai competitor. È muoversi in modo disordinato, adottando strumenti multipli senza un framework di governance, accumulando integrazioni fragili e generando aspettative che i processi interni non sono ancora in grado di sostenere.

L’approccio più efficace è anche il più disciplinato: identificare un singolo caso d’uso operativo con perimetro definito, costruire un contesto versionato per gli agenti coinvolti, connettere uno o due sistemi esistenti attraverso MCP, misurare il valore prodotto su metriche concrete e verificabili.

Casi d’uso adatti a questa fase iniziale includono: analisi automatizzata dei log applicativi, generazione e validazione di query su dataset noti, supporto alle pipeline di test, produzione di dashboard operative su dati strutturati esistenti. Casi d’uso che hanno in comune una caratteristica: il prima e il dopo sono misurabili, e gli errori emergono rapidamente nel perimetro controllato anziché propagarsi su scala.

Se il caso pilota produce valore misurabile, l’estensione è giustificata. Se emergono criticità (sui dati, sui permessi, sulle responsabilità, sull’adozione) è preferibile che emergano in questa fase, dove il costo di correzione è contenuto.

MCP sta diventando un discriminante reale nella valutazione degli strumenti AI non perché sia uno standard tecnicamente rivoluzionario, ma perché impone una domanda matura: questo strumento funziona nel contesto specifico in cui deve operare, con i vincoli reali che quel contesto porta con sé? Per le organizzazioni che devono prendere decisioni di adozione fondate su evidenze anziché su entusiasmo, è la domanda giusta da cui partire.