Nel panorama tecnologico odierno, la serverless architecture rappresenta una delle evoluzioni più significative per chi fa impresa. Nonostante il nome suggerisca l’assenza di macchine fisiche, il termine indica in realtà un radicale cambio di prospettiva: la tecnologia si adegua al business, e non viceversa.

Serverless oltre il concetto di server: l’infrastruttura diventa invisibile

Chiarendo un punto fondamentale, i server esistono ancora, la caratteristica è che per l’azienda diventano completamente invisibili.

In un modello tradizionale, un’impresa deve preoccuparsi di acquistare, configurare e manutenere i propri computer (fisici o virtuali). Con il serverless, tutto questo sparisce. La gestione dell’infrastruttura, ovvero la manutenzione, gli aggiornamenti di sicurezza e il controllo dei componenti, viene delegata interamente al fornitore cloud (come Amazon, Google o Microsoft). È un po’ come passare dalla gestione di un intero acquedotto al semplice gesto di aprire il rubinetto: l’acqua arriva solo quando serve e non ci si deve preoccupare delle tubature.

Investire nel serverless: dal “ferro” al valore

Il suo successo nasce da un’esigenza strategica: liberare risorse.

- Efficienza operativa: i team di sviluppo non perdono più ore preziose in configurazioni complesse. Possono dedicarsi esclusivamente a ciò che crea valore per i clienti: la logica dell’applicazione e le sue funzionalità.

- Riduzione degli sprechi: si paga solo per l’uso effettivo. Se l’applicazione non viene usata, i costi si azzerano, eliminando l’onere di pagare server accesi ma inutilizzati.

- Velocità di risposta: questo modello permette di lanciare nuovi prodotti o servizi sul mercato molto più velocemente rispetto ai sistemi tradizionali.

Questa architettura sta ridefinendo gli standard del mercato. Analizzeremo come funziona e perché oggi, per un titolare d’azienda o un responsabile tecnico, comprendere il serverless significhi comprendere come rendere la propria impresa più agile, sicura e pronta alle sfide del futuro digitale.

Come funziona l’architettura serverless

Il funzionamento di un’architettura serverless si fonda su un modello definito “event-driven” (basato sugli eventi). A differenza dei sistemi tradizionali, in cui un server rimane costantemente acceso in attesa di lavoro, qui il codice rimane inattivo fino a quando non riceve un segnale specifico.

Questo “impulso” può essere una richiesta da un sito web, il caricamento di un documento in un archivio o un’azione programmata nel tempo. Solo in quel momento il fornitore cloud attiva istantaneamente le risorse necessarie, esegue il compito e, una volta terminato, le rilascia immediatamente. Questo meccanismo garantisce un’efficienza totale: non esistono componenti che consumano energia o generano costi mentre restano inattivi.

FaaS (Function as a Service): il motore del sistema

Il cuore tecnologico di questo modello è il paradigma FaaS. In questo scenario, le applicazioni vengono suddivise in piccole unità di codice indipendenti, chiamate “funzioni”, ognuna progettata per svolgere un unico compito specifico (ad esempio: ridimensionare una foto o inviare un’email di conferma).

Servizi leader come AWS Lambda, Azure Functions o Google Cloud Functions operano seguendo questo schema:

- Isolamento: ogni funzione viene eseguita in un ambiente protetto e temporaneo.

- Ciclo di vita breve: l’ambiente di calcolo viene creato in pochi millisecondi e distrutto non appena il compito è concluso.

- Scalabilità automatica: se arrivano mille richieste contemporaneamente, il sistema crea istantaneamente mille copie della funzione per gestirle, tornando a zero un secondo dopo.

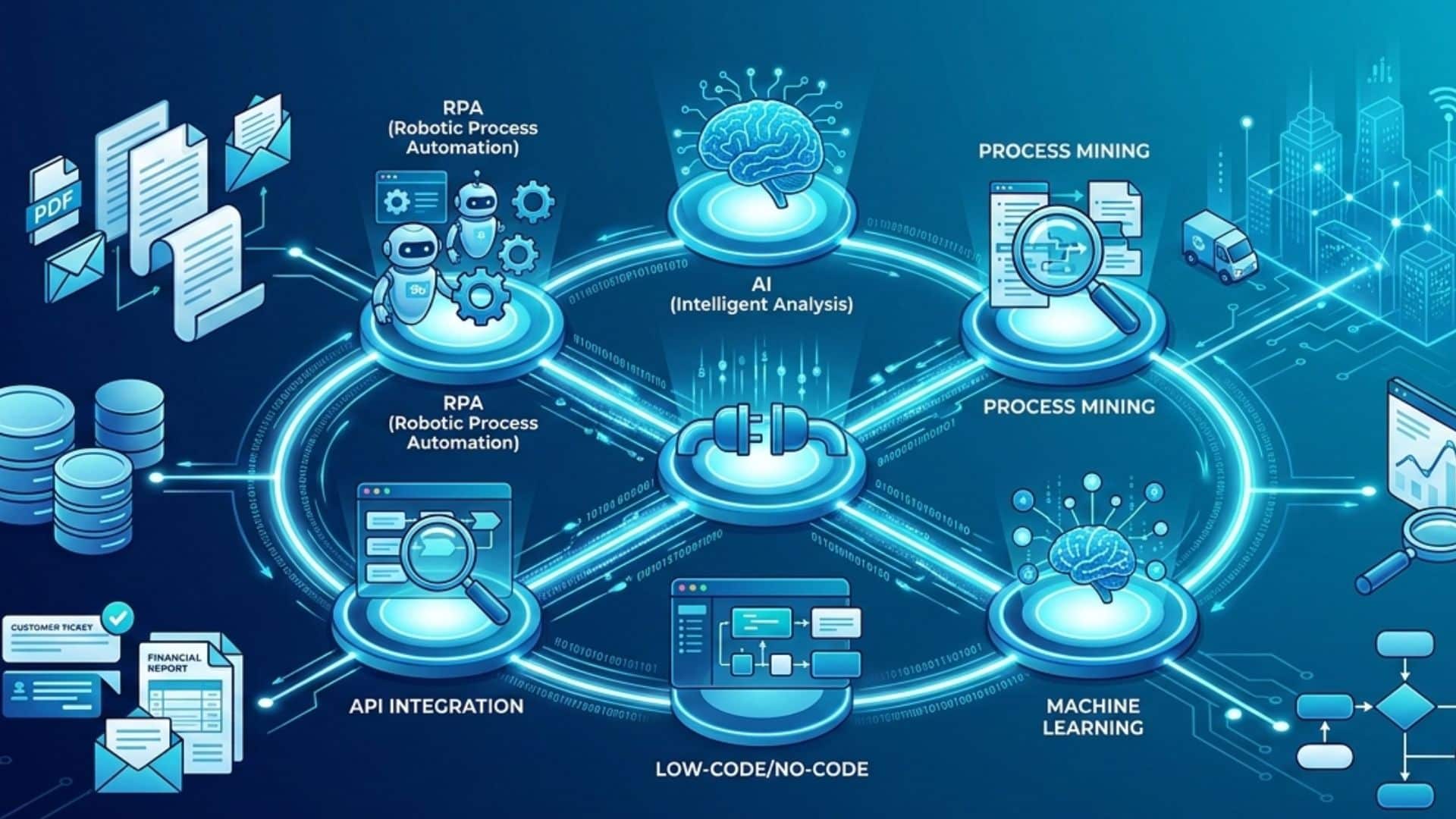

BaaS (Backend as a Service): i componenti pronti all’uso

Per costruire un’applicazione completa, alle funzioni (FaaS) vengono affiancati i servizi BaaS. Si tratta di componenti già pronti e interamente gestiti dal fornitore cloud che risolvono esigenze comuni senza dover scrivere codice complesso:

- Database gestiti: per archiviare dati in modo sicuro.

- Sistemi di autenticazione: per gestire l’accesso degli utenti (login).

- Storage e notifiche: per conservare file o inviare messaggi.

L’integrazione tra FaaS e BaaS permette di assemblare architetture modulari e robuste, riducendo drasticamente la complessità tecnica del “dietro le quinte” (il backend).

Il workflow tipico: un processo lineare e automatizzato

Il flusso di lavoro in un ambiente serverless segue una sequenza logica estremamente fluida:

- L’attivazione: si verifica un evento (es. un utente clicca su “Acquista”).

- L’esecuzione: il provider avvia l’ambiente e la funzione specifica elabora i dati.

- La risposta: il sistema restituisce il risultato (es. conferma dell’ordine).

- Il rilascio: l’ambiente viene eliminato e il consumo di risorse si interrompe.

L’intero ciclo avviene in modo trasparente e automatizzato, permettendo di focalizzare l’attenzione esclusivamente sul risultato finale e sulla logica del servizio.

I 4 pilastri del successo serverless

La serverless architecture offre vantaggi che la rendono particolarmente interessante per molte applicazioni moderne. Il primo riguarda la scalabilità automatica. Quando il numero di richieste aumenta, il provider avvia più istanze della funzione per gestire il carico. Quando il traffico diminuisce, le istanze vengono ridotte senza intervento umano. Questo comportamento elimina la necessità di configurare sistemi di bilanciamento del carico o di prevedere in anticipo la capacità necessaria.

Un secondo vantaggio è il modello di costo pay‑per‑use. Con la serverless architecture si paga solo per il tempo effettivo di esecuzione del codice. Non esistono costi legati a server inattivi o risorse allocate ma non utilizzate. Questo approccio risulta conveniente per applicazioni con traffico variabile o imprevedibile, perché permette di ottimizzare il budget e di investire le risorse in modo più mirato.

Un terzo elemento riguarda l’agilità operativa. Gli sviluppatori possono concentrarsi sulla logica applicativa, riducendo il tempo necessario per portare un’idea in produzione. L’assenza di infrastruttura da gestire semplifica il processo di sviluppo e permette di sperimentare con maggiore rapidità, favorendo cicli di rilascio più fluidi.

Infine, la sicurezza rappresenta un ulteriore punto di forza. Il provider cloud si occupa della protezione dell’infrastruttura, dell’applicazione delle patch e della gestione del sistema operativo. Questo riduce il rischio di vulnerabilità legate a configurazioni errate o a componenti non aggiornati, offrendo un ambiente affidabile e costantemente monitorato.

Serverless vs architetture tradizionali

Le infrastrutture tradizionali si muovono lungo una scala di flessibilità crescente, ma portano con sé oneri di gestione costanti.

Le architetture convenzionali: dal ferro ai container

- Server fisici (on-premise): rappresentano l’approccio classico. Offrono il controllo totale sull’hardware, ma richiedono investimenti iniziali elevati (CapEx), manutenzione fisica e tempi lunghi per l’aggiornamento.

- Macchine virtuali (IaaS): sono server simulati via software nel cloud. Garantiscono maggiore agilità rispetto ai server fisici, ma comportano comunque costi fissi (si paga l’istanza anche se inutilizzata) e la necessità di gestire patch, aggiornamenti e sicurezza del sistema operativo.

- Container (PaaS/Kubernetes): costituiscono un’evoluzione importante, permettendo di isolare le applicazioni e spostarle facilmente tra diversi ambienti. Tuttavia, richiedono una complessa attività di orchestrazione: qualcuno deve comunque decidere quanti “contenitori” attivare e gestire i cluster di macchine che li ospitano.

Il salto di qualità: l’astrazione totale del serverless

La serverless architecture si colloca a un livello superiore di astrazione. Qui l’infrastruttura non viene semplicemente “noleggiata”, ma scompare completamente dalla vista dell’utilizzatore.

La differenza fondamentale rispetto ai modelli precedenti si riassume in tre pilastri:

- Allocazione dinamica delle risorse: mentre in un’architettura tradizionale bisogna “prenotare” una certa quantità di potenza (spesso sovrastimandola per evitare blocchi), nel serverless l’applicazione si adatta automaticamente e istantaneamente alla domanda effettiva.

- Eliminazione dei componenti sempre attivi: in una struttura classica, il server (o il container) deve rimanere acceso in attesa di lavoro. Nel serverless, le risorse vengono attivate solo per i millisecondi necessari all’elaborazione, eliminando lo spreco energetico ed economico.

- Riduzione della complessità operativa: il team tecnico non deve più configurare bilanciatori di carico o sistemi di ridondanza. Queste funzioni sono “native” e garantite dal provider cloud.

Serverless: un cambio di paradigma

Invece di gestire “macchine”, si gestiscono “servizi”. Questo passaggio sposta il focus operativo: non ci si occupa più della stabilità del contenitore, ma della qualità del contenuto. Se i modelli tradizionali richiedono una gestione attiva dei cluster, il serverless offre un ambiente in cui l’infrastruttura è un servizio fluido e invisibile che segue perfettamente l’andamento del business.

I “contro”: quando il Serverless non è la scelta giusta

La serverless architecture presenta anche alcune sfide. Una delle più note è il fenomeno del cold start. Quando una funzione rimane inattiva per un certo periodo, il provider deve avviare un nuovo ambiente di esecuzione prima di elaborare la richiesta successiva. Questo può introdurre un ritardo percepibile, soprattutto in applicazioni che richiedono tempi di risposta molto rapidi.

Un’altra considerazione riguarda il rischio di dipendenza dal provider. Ogni piattaforma offre servizi e strumenti proprietari che possono rendere complessa una migrazione futura verso un altro ambiente. La scelta del provider diventa quindi una decisione strategica che richiede attenzione.

La natura distribuita delle applicazioni serverless può rendere più complesso il debugging. Le funzioni vengono eseguite in ambienti isolati e spesso interagiscono con numerosi servizi esterni. Tracciare un errore lungo un flusso di eventi può richiedere strumenti avanzati di osservabilità e logging.

Esistono anche limiti legati alla durata delle funzioni e alla quantità di risorse disponibili. Le funzioni serverless sono progettate per eseguire compiti brevi e stateless. Attività che richiedono elaborazioni prolungate o un uso intensivo della CPU potrebbero non essere adatte a questo modello.

Casi d’uso reali: dove brilla il serverless

La serverless architecture si dimostra efficace in diversi scenari.

Nel settore e‑commerce permette di gestire picchi di traffico senza interventi manuali, garantendo continuità e prestazioni costanti.

Nel mondo IoT consente di elaborare una grande quantità di eventi provenienti da sensori distribuiti, offrendo un modello naturale per applicazioni basate su segnali frequenti e di piccola entità.

Nei processi di automazione backend risulta ideale per attività come la generazione di PDF, il ridimensionamento di immagini o l’invio di notifiche automatiche. La sua versatilità la rende adatta a molte applicazioni moderne, soprattutto quando la scalabilità e l’efficienza sono priorità.

Prossimi Passi

La serverless architecture rappresenta un modello flessibile, efficiente e orientato al valore. Offre vantaggi significativi in termini di scalabilità, costi, sicurezza e velocità di sviluppo.

La sua adozione richiede una valutazione attenta delle esigenze del progetto, ma quando viene applicata nel contesto giusto può portare benefici concreti.

Comprendere il suo funzionamento e i suoi punti di forza permette di sfruttarne appieno il potenziale e di progettare soluzioni moderne, resilienti, perfettamente allineate alle sfide dei mercati digitali più evoluti e proiettate verso standard tecnologici d’avanguardia.