L’evoluzione tecnologica del 2026 ha trasformato l’impronta carbonica del comparto IT in una variabile critica per l’etica d’impresa e la stessa sopravvivenza economica. In un contesto di costi energetici volatili e normative ambientali stringenti, adottare rigorose strategie di green computing è ormai un requisito architettonico, non più un’opzione. L’obiettivo supera il semplice ‘consumare meno’: è fondamentale ottimizzare l’intero ciclo di vita del software e dell’hardware, passando da una logica di abbondanza di risorse a una di efficienza algoritmica e strutturale.

Analisi dei carichi e strategie green computing nel cloud

Il primo passo per un’infrastruttura moderna si focalizza nell’ottimizzazione dell’allocazione delle risorse. Spesso, le aziende pagano per risorse cloud che rimangono sottoutilizzate, generando sprechi energetici latenti. Le strategie green computing più efficaci partono dal concetto di right-sizing: l’allineamento preciso tra la potenza computazionale allocata e il carico di lavoro reale.

Tecnicamente, questo si traduce nell’adozione di istanze basate su architettura ARM, che garantiscono un rapporto performance-per-watt superiore rispetto ai sistemi x86 tradizionali. L’implementazione di auto-scaling predittivo basato su machine learning permette poi di ottimizzare i nodi durante i cali di domanda. Gestire i carichi in modo dinamico evita che i server girino a vuoto, riducendo drasticamente le emissioni di CO2 legate alla dissipazione termica.

Comparazione efficienza architetture CPU

Perché passare ad ARM è una scelta tecnica vincente? Ecco un confronto sul rapporto performance/watt:

| Caratteristica | Architettura x86 (Tradizionale) | Architettura ARM (Innovativa) | Impatto green |

| Consumo energetico | Elevato (progettato per alte performance di picco) | Ottimizzato (progettato per efficienza) | Riduzione calore prodotto |

| Istruzioni | CISC (complesse, richiedono più energia) | RISC (ridotte, eseguite più velocemente) | Minor tempo di calcolo |

| Raffreddamento | Richiede sistemi attivi costosi | Spesso gestibile con sistemi passivi | Risparmio energia ausiliaria |

Questa ottimizzazione hardware deve essere però supportata da una gestione intelligente dell’infrastruttura. L’adozione di sistemi di auto-scaling predittivo rappresenta un salto evolutivo rispetto al passato: queste tecnologie non si limitano a reagire al carico attuale della CPU, ma utilizzano algoritmi di machine learning per analizzare i pattern storici e anticipare l’avvio dei server necessari. In questo modo si evita l’approvvigionamento eccessivo di emergenza, riducendo gli sprechi energetici. Parallelamente, una strategia consapevole non può prescindere dalla scelta della localizzazione geografica. Scegliere di ospitare i propri carichi di lavoro in aree cloud alimentate interamente da fonti rinnovabili, come i data center situati in Nord Europa o in Canada, permette di abbattere drasticamente l’impronta di carbonio alla base, rendendo l’intero asset digitale nativamente sostenibile.

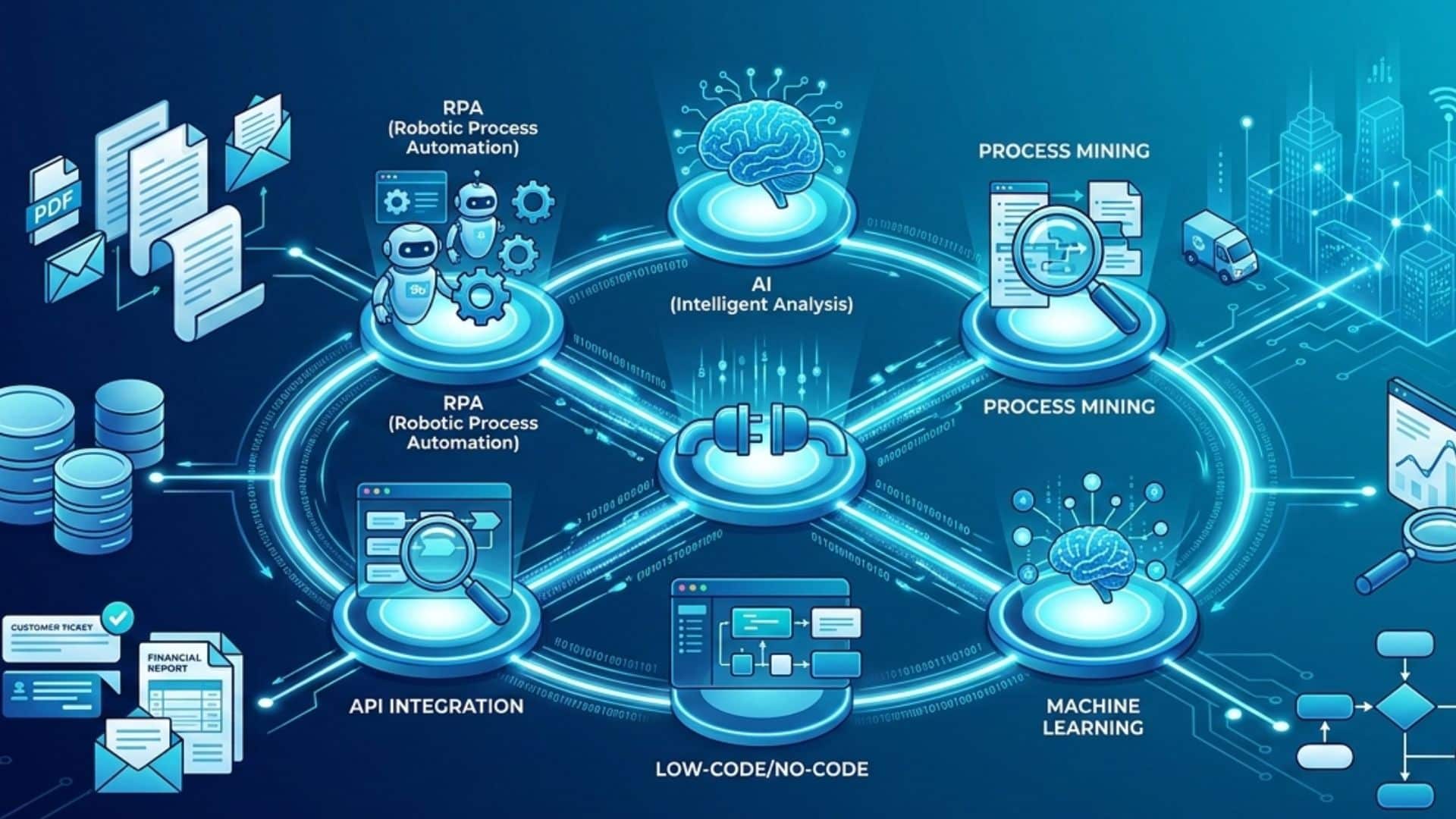

Architetture serverless come strategie green computing

L’approccio serverless minimizza l’idle time, ovvero il tempo di inattività, che è il principale responsabile del consumo energetico inefficiente nei sistemi informativi. Integrare queste strategie permette alle organizzazioni di passare da una gestione rigida a una composizione di microservizi agili che consumano energia solo nel millisecondo esatto in cui producono valore. Questo cambio di paradigma si concretizza attraverso tre vantaggi operativi fondamentali:

- Deallocazione istantanea: a differenza dei server sempre accesi, il modello FaaS (Function-as-a-Service) azzera il consumo quando non ci sono eventi da processare.

- Modularità operativa: permette di scalare solo la specifica funzione necessaria, evitando di alimentare un intero sistema operativo per un singolo task.

- Riduzione dell’overhead: elimina la necessità di gestire macchine virtuali (VM) pesanti, ottimizzando l’uso della RAM fisica nel data center del provider.

Ottimizzazione del codice e strategie green computing

Un algoritmo scritto in modo inefficiente richiede più cicli di CPU e memoria RAM, aumentando il consumo elettrico. All’interno delle strategie green computing aziendali, lo sviluppo di green code è un pilastro fondamentale.

La scelta del linguaggio di programmazione è il primo fattore tecnico: linguaggi compilati come Rust o C++ sono estremamente più efficienti rispetto a linguaggi interpretati per compiti intensivi. Inoltre, l’ottimizzazione delle query e la riduzione della ridondanza dei dati minimizzano i tempi di I/O (Input/Output). La progettazione software deve integrare l’efficienza energetica come una metrica di qualità pari alla sicurezza. La seguente comparazione tecnica mette in luce le differenze di consumo energetico tra i principali linguaggi di programmazione, confermando l’importanza di una scelta tecnologica consapevole.

Ranking efficienza linguaggi (Energy Consumption)

| Linguaggio | Indice di Consumo Energetico | Note Tecniche |

| C / Rust | 1.00 (Benchmark) | Massima efficienza, gestione manuale della memoria. |

| C++ | 1.34 | Ottimo per calcolo parallelo e sistemi critici. |

| Java | 1.98 | Buono, ma influenzato dal garbage collector (JVM). |

| JavaScript | 4.45 | Elevato overhead dovuto all’interpretazione JIT. |

| Python | 75.88 | Molto energivoro; richiede ottimizzazioni in C per carichi pesanti. |

Data observability per il successo delle strategie green computing

Non si può migliorare ciò che non si può misurare. Il monitoraggio deve scendere nel dettaglio del singolo microservizio tramite sistemi avanzati di data observability, questi servizi sono:

- PUE (Power Usage Effectiveness): il rapporto tra l’energia totale usata dal data center e quella usata solo dagli apparati IT. L’obiettivo è avvicinarsi a 1.0.

- Carbon intensity tracking: misura la quantità di CO2 prodotta per kilowattora in base all’ora del giorno (permettendo di spostare task pesanti nelle ore in cui l’energia è più pulita).

- Telemetry IoT: sensori fisici nei rack per mappare i “punti caldi” e ottimizzare i flussi d’aria del condizionamento.

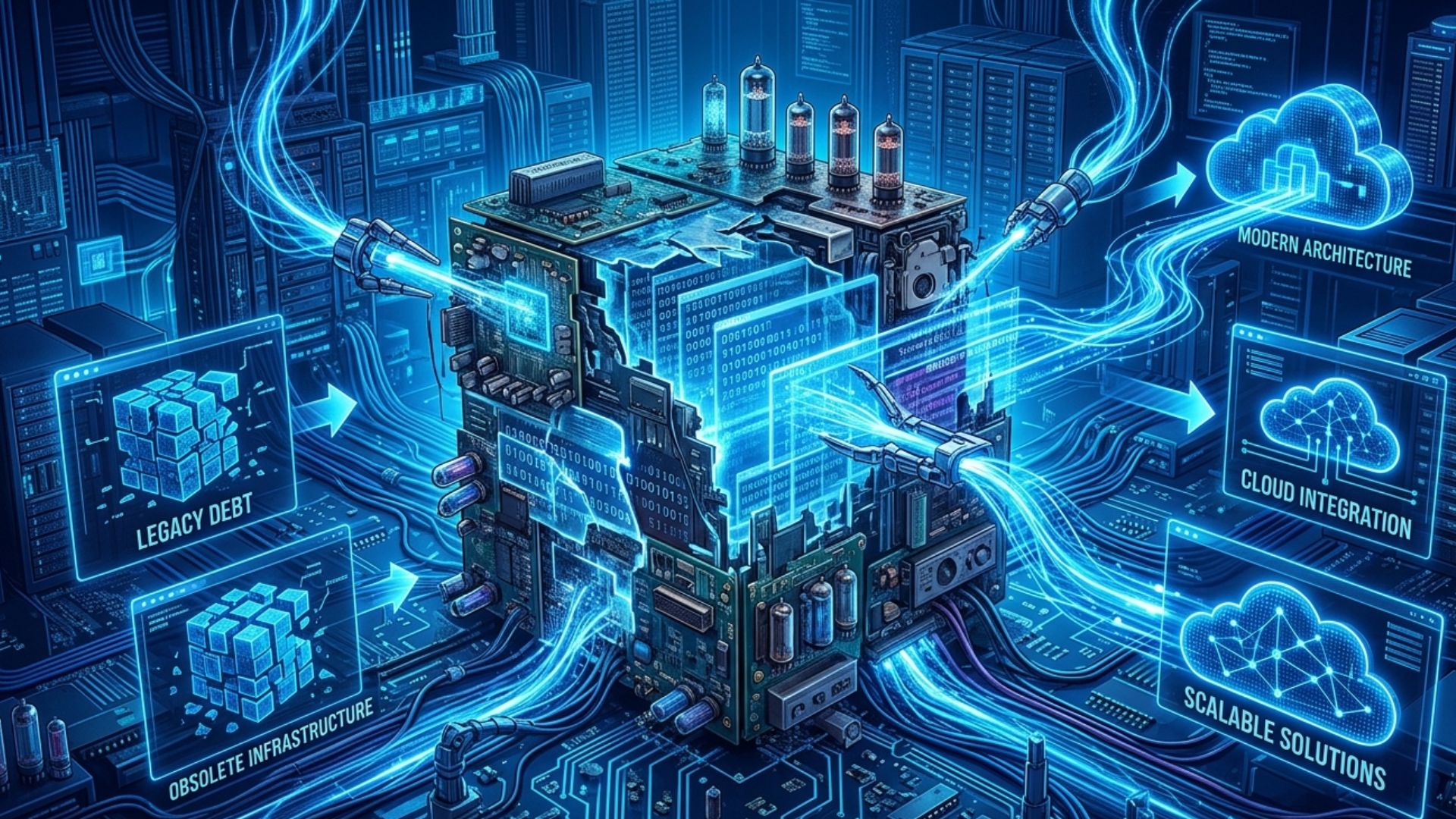

Modernizzazione del legacy e strategie green computing

Il debito tecnico è uno dei maggiori ostacoli alla sostenibilità. I sistemi legacy, spesso basati su software obsoleti e hardware energivoro, sono incompatibili con le moderne strategie green computing. Modernizzare questi sistemi non significa solo migliorare le prestazioni, ma abbattere i costi fissi di mantenimento energetico.

La strategia tecnica prevede la containerizzazione delle applicazioni tramite Docker e l’orchestrazione con Kubernetes. Questo processo permette di isolare i carichi di lavoro e farli girare su hardware moderno molto più efficiente, riducendo la necessità di mantenere server fisici dedicati a singole vecchie applicazioni. Inoltre, la transizione verso il cloud ibrido permette di spostare i carichi più pesanti verso data center che utilizzano energia prodotta da fonti rinnovabili, dismettendo le vecchie server room locali che spesso mancano di sistemi di raffreddamento ottimizzati. L’efficacia di questa modernizzazione poggia su tre pilastri tecnici:

- Containerizzazione (Docker): permette di densificare le applicazioni, facendo girare 10 servizi dove prima servivano 10 server fisici.

- Orchestrazione (Kubernetes): gestisce la distribuzione dei carichi sulle macchine più efficienti, spegnendo quelle inutilizzate (Bin Packing).

- Cloud ibrido: mantenere on-premise solo lo stretto necessario e delegare i carichi variabili a cloud provider con standard ambientali certificati.

Sostenibilità dei dati nelle strategie green computing nello storage

La gestione dei dati è un pilastro centrale delle strategie green computing. Archiviare petabyte di dati freddi, ovvero mai utilizzati, su storage ad alte prestazioni è un errore tecnico ed energetico costoso. La strategia prevede l’implementazione di tiered storage: un sistema che distribuisce i dati in base alla loro frequenza di utilizzo: mentre le informazioni critiche risiedono su unità SSD o NVMe ad alte prestazioni (Hot Tier), i dati consultati saltuariamente vengono spostati su dischi HDD (Warm Tier) per ottimizzare il rapporto costo-energia. Per l’archiviazione a lungo termine, si ricorre invece a soluzioni come nastri o servizi di archivio “cold” (Cold Tier), che garantiscono un consumo elettrico quasi nullo quando non sono in fase di lettura.

La gestione consapevole del patrimonio dati nello storage

Questo approccio strutturale deve essere supportato da tecniche di deduplicazione, fondamentali per eliminare le copie ridondanti dello stesso file e ridurre lo spazio fisico occupato nei data center. Meno unità alimentate si traducono direttamente in una minore produzione di calore e in un risparmio energetico netto. A completare il quadro di una gestione IT responsabile intervengono le Data Purge Policy (politiche di eliminazione sicura dei dati obsoleti): l’uso di script automatizzati provvedono alla cancellazione sistematica di log e file temporanei dopo un periodo prestabilito. In questo modo, la conservazione dei dati smette di essere un peso inerziale per diventare un processo ottimizzato, dove ogni bit conservato ha un senso logico e un impatto ambientale giustificato.

Come analizzato, trasformare l’infrastruttura digitale in un asset sostenibile non è solo una missione etica; è una mossa strategica per garantire la resilienza economica in un mercato sempre più attento all’efficienza algoritmica e strutturale.